目次

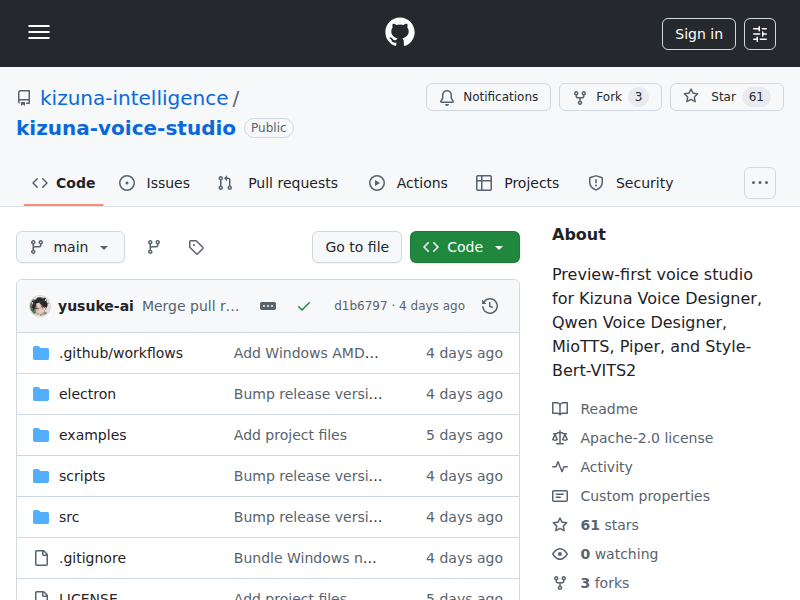

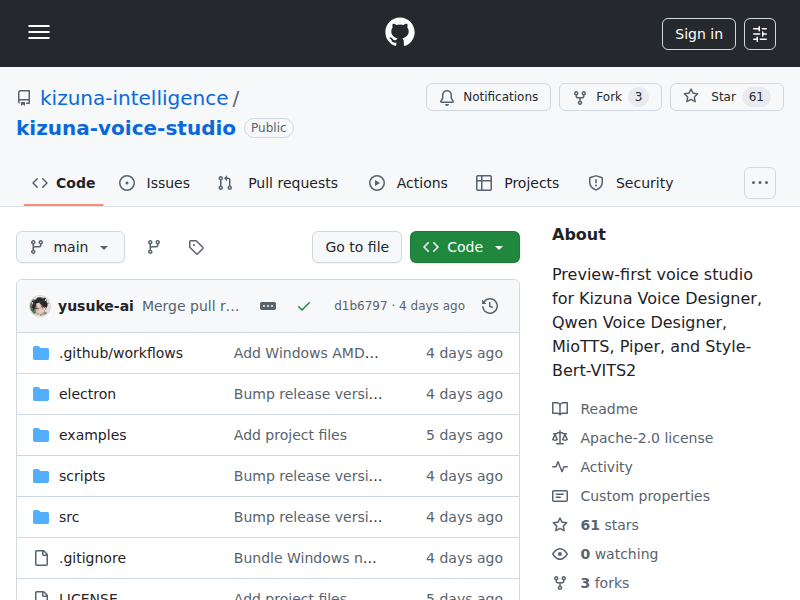

2026 年 3 月、個人開発者によって「Kizuna Voice Studio」が GitHub で公開された。これは自分だけの読み上げ音声を作るためのデスクトップアプリで、難しい設定を排し「日本語で声の説明を書く→種音声を聞く→TTS を作る」という 3 ステップでオリジナル音声モデルを作成できる。

GitHub リポジトリ画面。対応モデル、配布形態、関連リポジトリへの導線が一目で確認できる。

何ができたか

Kizuna Voice Studio の核心は、GUI だけで完結する音声合成ワークフローだ。ユーザーはまず「どんな声にしたいか」を日本語で入力する。アプリは入力された説明から「種音声」を生成し、ユーザーはそれを聞いて確認する。問題なければ、Piper TTS または Style-Bert-VITS2 を選んで学習し、最終的に Python パッケージとして書き出せる。

また、学習をスキップして MioTTS 用の参照音声パッケージを作ることも可能だ。この場合、参照音声ファイルを同封した zip を作成し、MioTTS の zero-shot API で音声生成する。

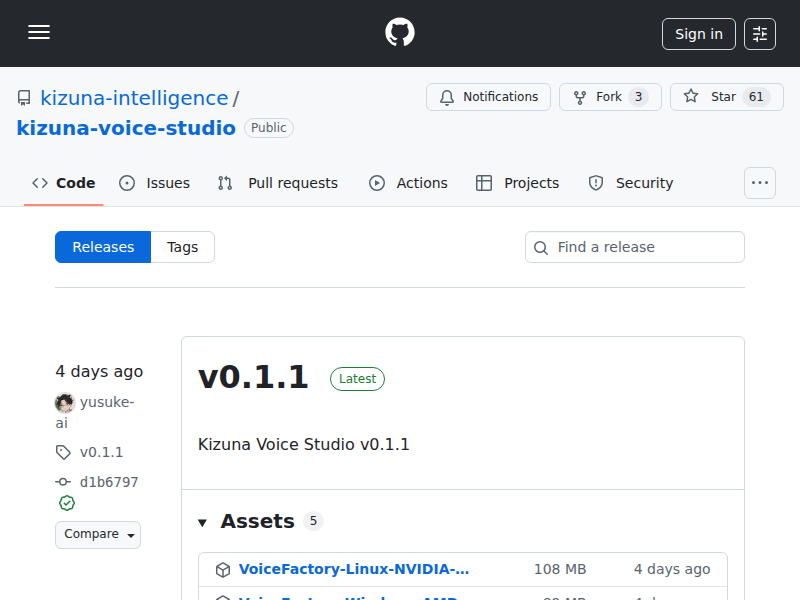

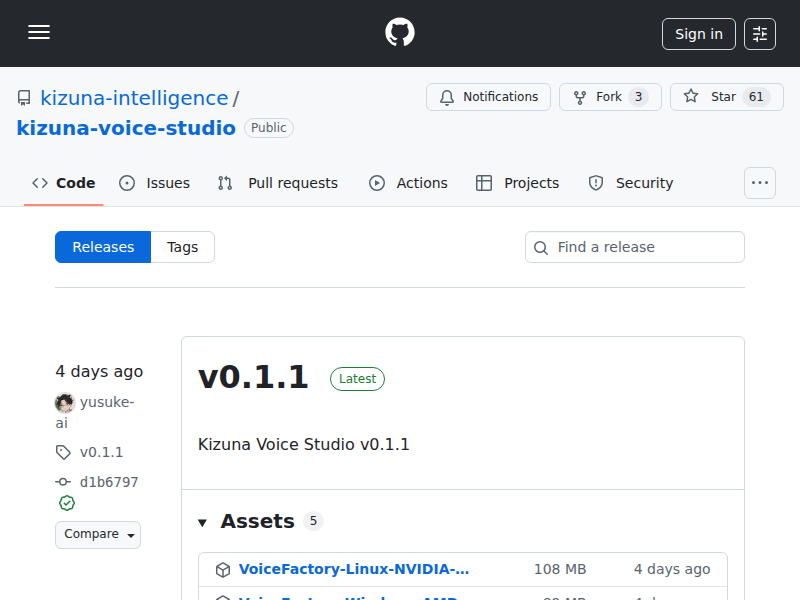

最新版は v0.1.1(2026 年 3 月 18 日)。Windows(NVIDIA GPU 版 / AMD 版)、Linux(NVIDIA GPU 版)、macOS(Apple Silicon 版)の 4 環境に対応している。

GitHub Releases。配布対象の OS と最新バージョンを確認できる。

何が以前と違うか

従来の音声合成モデルの学習には、コマンドライン操作や Python 環境の構築、ハイパーパラメーターの調整など、技術的な知識が求められた。Kizuna Voice Studio はこの参入障壁を下げ、非技術者でもオリジナル音声を作れるように設計されている。

具体的な特徴は以下の三点に集約される。

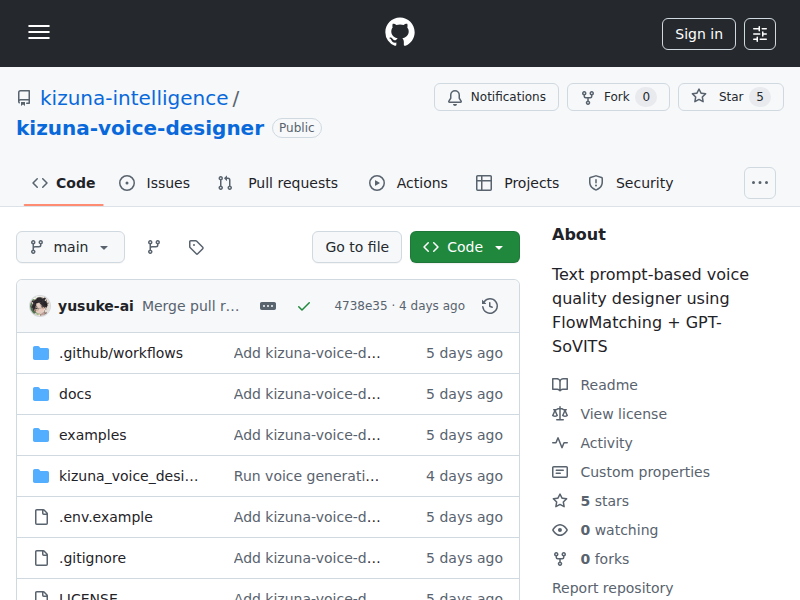

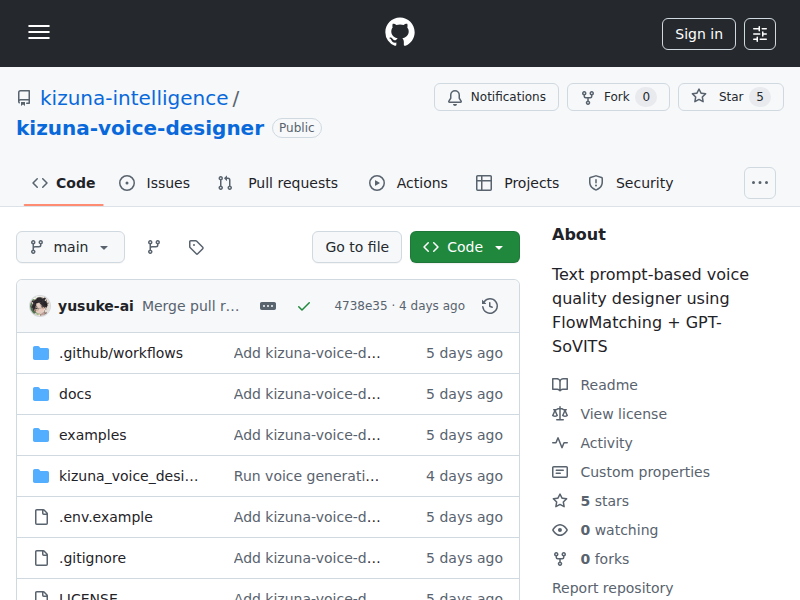

第一に、日本語での直感的な声の設計。Kizuna Voice Designer または Qwen Voice Designer を使用し、「低めの男性声で、少し落ち着いた感じ」といった自然言語の説明から種音声を生成できる。翻訳モデルを挟まないため、日本語のニュアンスがそのまま反映される。

Kizuna Voice Designer 側のリポジトリ。Studio の前段にある voice design の位置づけを補足できる。

第二に、3 種類の TTS モデルから選択可能。Piper TTS(軽量・CPU 動作向け)、Style-Bert-VITS2(高表現力・感情表現向け)、MioTTS(参照音声ベース・学習不要)の 3 つから用途に合わせて選べる。迷った場合のガイドもアプリ内に用意されている。

第三に、Python パッケージとしての書き出し。学習済みのモデルは zip ファイルとしてエクスポートされ、pip install でインストール可能。これにより、開発者は自分のアプリや作品に簡単に音声合成機能を組み込める。

技術的な仕組み

アプリは Electron と backend を分離した構成を採用している。backend は FastAPI で実装されており、CLI や Gradio からも利用可能だ。重い処理(音声生成、学習)はジョブ単位の別プロセスで実行され、処理完了後は GPU を解放する設計になっている。

モデルはアプリ本体に同梱せず、必要になったタイミングで自動ダウンロードされる。初回起動時には Python 実行環境のセットアップ、依存ライブラリのインストール、モデルのダウンロードが行われるため、多少の待ち時間がある。

Windows 配布版では、jieba-fast などのネイティブ拡張は初回ビルドせず、配布時点で必要な wheel を同梱している。これにより、ユーザー環境でのビルド失敗を防いでいる。

誰にどの程度影響するか

影響を受けるのは主に二つの層だ。

開発者層。自分のアプリやゲーム、コンテンツにオリジナル音声を組み込みたい開発者にとって、参入障壁が大幅に下がる。特に、キャラクターに声を付けたいインディーゲーム開発者や、AI アシスタントに個性的な音声を付けたいプロトタイパーにとって有用だ。

コンテンツ制作者層。ボイスコンテンツの制作コストを下げられる可能性がある。ただし、既存の音声合成サービスとの差別化や、倫理的な配慮(声の無断利用、なりすまし防止)は別途必要となる。

対応環境と選び方

現在の配布版は、NVIDIA GPU または Apple Silicon を前提としている。

- Windows / Linux で NVIDIA GPU がある人:

windows-nvidiaまたはlinux-nvidia - Windows で AMD GPU の人:

windows-amd(CPU/互換経路優先のため NVIDIA 版より遅い) - macOS で Apple Silicon の人:

macos-apple-silicon

CPU 版は現時点で実用性が低いため、配布対象から外れている。

モデルの選び方

Piper TTS は非常に軽量で、CPU や低スペック環境でも動作しやすい。モバイルや組み込み用途に向くが、表現力は Style-Bert-VITS2 より控えめだ。

Style-Bert-VITS2 は Piper TTS より表現力が高く、感情や話し方のニュアンスを出しやすい。その分、やや強力なマシンが必要になる。低めの男性声は Style-Bert-VITS2 の方が安定しやすい傾向がある。

MioTTS は学習不要で、参照音声だけで音声生成できる。Aratako/MioTTS-1.7B を既定で使用し、手元で API を立てている場合は api_base_url を差し替えて利用可能だ。

今すぐ注目すべき論点

技術的な注目点は、Electron と backend の分離設計だ。このアーキテクチャにより、GUI アプリだけでなく、CLI ツールや Web アプリからも同じ音声合成機能を共有できる。将来的に独立したオープンソースプロジェクトとして発展する可能性がある。

実用的な注目点は、書き出した Python パッケージの使いやすさ。pip install だけでインストールでき、シンプルな API で音声合成が可能になる。これは個人開発者だけでなく、企業内のプロトタイピングでも有用だ。

倫理的な注目点は、音声合成技術の悪用リスクだ。品質が向上し、誰でもオリジナル音声を作れるようになるほど、声の無断利用やなりすましの問題が顕在化する。オープンソースプロジェクトとして、どのようなガイドラインや利用規約を設けるのか、今後の動向が注目される。

Kizuna Voice Studio は、音声合成技術の民主化を推進するツールだ。技術的な知識がなくても、日本語で声の説明を書くだけでオリジナル音声を作れる。開発者にとっては、自分のプロジェクトに個性的な音声を簡単に加える手段が増えた。一般ユーザーにとっては、自分だけの声を作る体験が身近になる。

今後は、より多くの言語対応や、リアルタイム音声変換機能の追加などが期待される。GitHub リポジトリは公開されており、Issues や Pull Requests でコミュニティからの貢献も受け付ける体制だ。

引用元・参考リンク

GitHub - kizuna-intelligence/kizuna-voice-studio: Preview-first voice studio for Kizuna Voice Designer, Qwen Voice Designer, MioTTS, Piper, and Style-Bert-VITS2

Preview-first voice studio for Kizuna Voice Designer, Qwen Voice Designer, MioTTS, Piper, and Style-Bert-VITS2 - kizuna-intelligence/kizuna-voice-studio

Releases · kizuna-intelligence/kizuna-voice-studio

Preview-first voice studio for Kizuna Voice Designer, Qwen Voice Designer, MioTTS, Piper, and Style-Bert-VITS2 - kizuna-intelligence/kizuna-voice-studio

GitHub - kizuna-intelligence/kizuna-voice-designer: Text prompt-based voice quality designer using FlowMatching + GPT-SoVITS

Text prompt-based voice quality designer using FlowMatching + GPT-SoVITS - kizuna-intelligence/kizuna-voice-designer

免責事項 — 掲載情報は執筆時点のものです。料金・機能は変更される場合があります。最新情報は各公式サイトをご確認ください。