目次

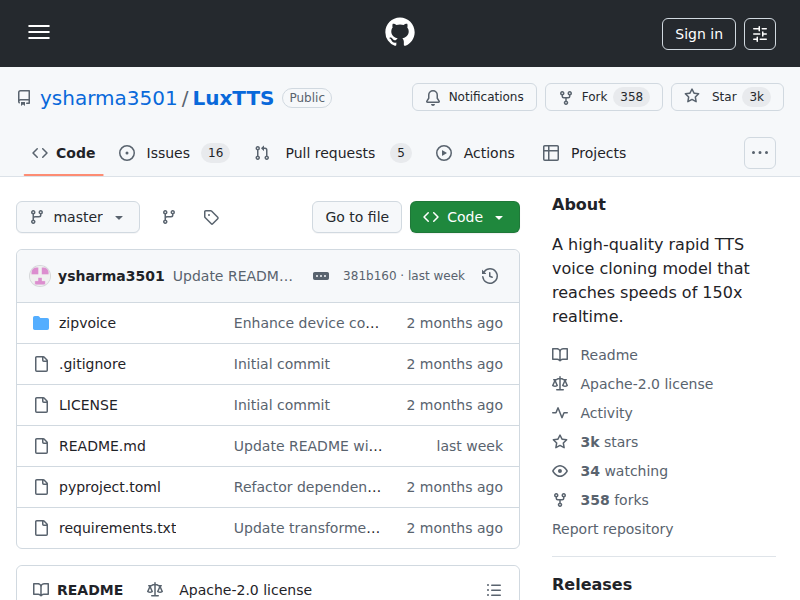

2026 年 3 月、X(旧 Twitter)で「ElevenLabs 級の音声クローニングが完全オフラインで動作する」と話題の LuxTTS が注目を集めている。これは 3 秒の音声から音声をクローニングし、150 倍のリアルタイム速度で動作するオープンソースの TTS(Text-to-Speech)モデルだ。

本稿は LuxTTS の技術的特徴、セットアップ方法、実用性を解説する。

何ができたか

LuxTTS は以下の 3 つの主要機能を備えている。

第一に、ゼロショット音声クローニング。3 秒程度の参照音声から話者の音声をクローニングできる。話者ごとの学習やファインチューニングは不要だ。

第二に、超高速動作。GPU で 150 倍のリアルタイム速度、CPU でもリアルタイム以上で動作する。これにより、対話型アプリケーションやリアルタイム音声合成が可能になる。

第三に、軽量設計。VRAM 1GB で動作し、48kHz の高音質オーディオを出力する。標準的な TTS システムの 24kHz よりも高品質だ。

ライセンスは Apache-2.0 で、商用利用も含めて自由に利用可能だ。

技術的な仕組み

アーキテクチャ

LuxTTS は以下の設計思想に基づいている。

- 軽量トランスフォーマー: 従来の大規模 TTS モデルと比べ、パラメーター数を大幅に削減。それでも音声品質を維持している。

- 効率的な推論パイプライン: バッチ処理とストリーミング出力を最適化し、レイテンシを最小化。

- 48kHz ネイティブ出力: 24kHz で生成してからアップサンプリングするのではなく、最初から 48kHz で生成する。

対応環境

| 項目 | 要件 |

|---|---|

| VRAM | 1GB 以上(GPU 利用時) |

| CPU | 対応(リアルタイム動作可能) |

| OS | Windows, macOS, Linux |

| Python | 3.10 以上 |

音声品質

LuxTTS の音声品質は、主観的評価で ElevenLabs のマルチリンガルモデルに匹敵すると報告されている。特に以下の点で優れている。

- 自然なイントネーション: 文脈に応じた適切な抑揚

- 感情表現: 話者の感情をある程度再現

- 多言語対応: 英語、日本語、中国語など複数言語に対応

セットアップ方法

1. リポジトリのクローン

git clone https://github.com/ysharma3501/LuxTTS.git

cd LuxTTS

2. 依存関係のインストール

pip install -r requirements.txt

3. モデルのダウンロード

Hugging Face からモデルをダウンロードする。

python scripts/download_model.py

4. 推論の実行

from luxtts import LuxTTS

# モデルの初期化

tts = LuxTTS()

# 参照音声から音声をクローニング

reference_audio = "path/to/reference.wav"

tts.clone_voice(reference_audio)

# テキストを音声に変換

text = "こんにちは、これは LuxTTS のデモです。"

output = tts.synthesize(text)

# 音声ファイルを保存

tts.save(output, "output.wav")

5. Web デモ(オプション)

LuxTTS は Web デモも提供する。

python app.py

ブラウザで http://localhost:7860 にアクセスすると、Web UI で音声合成を試せる。

実用性:ElevenLabs との比較

| 項目 | LuxTTS | ElevenLabs |

|---|---|---|

| 音声クローニング | 3 秒 | 30 秒〜1 分 |

| 動作速度 | 150x リアルタイム | 10-50x リアルタイム |

| VRAM 要件 | 1GB | クラウドのみ |

| 音声品質 | 48kHz | 44.1kHz |

| 価格 | 無料(オープンソース) | 月額$5〜$330 |

| オフライン動作 | 可能 | 不可 |

| 商用利用 | 可能(Apache-2.0) | 有料プラン必要 |

メリット

- 完全オフライン: インターネット接続不要で動作

- コストゼロ: サブスクリプション不要

- プライバシー: 音声を外部サーバーに送信しない

- カスタマイズ: コードを自由に改変可能

デメリット

- セットアップの手間: 自分で環境構築が必要

- サポート: コミュニティベース(有料サポートなし)

- 機能制限: ElevenLabs の一部機能(感情制御、複数話者など)は未実装

ユースケース

1. ポッドキャスト・動画制作

自分の声でナレーションを自動生成。声優を雇うコストを削減できる。

2. ゲーム開発

NPC のセリフを動的に生成。プレイヤーの名前を呼びかけることも可能だ。

3. AI アシスタント

カスタム音声で AI アシスタントを構築。ブランドに合わせた音声デザインができる。

4. アクセシビリティ

視覚障害者向けの音声読み上げ。個人に最適化した音声を低コストで提供できる。

5. 教育コンテンツ

教材の音声を自動生成。多言語対応の教材も容易に作成できる。

注意点とリスク

1. 音声の悪用リスク

音声クローニング技術は、なりすましや詐欺に悪用される可能性がある。利用者は倫理的なガイドラインを遵守する必要がある。

2. 著作権

クローニングする音声の著作権に注意が必要だ。許可なく他者の声をクローニングすることは法的リスクを伴う。

3. ハードウェア要件

VRAM 1GB は軽量だが、古い GPU や統合 GPU では動作しない可能性がある。CPU モードも提供されているが、速度は低下する。

4. 多言語対応の限界

日本語を含む多言語に対応しているが、英語に比べて品質が低下する言語もある。実使用前に十分テストする必要がある。

結論:ローカル TTS の新基準

LuxTTS は、ElevenLabs 級の音声クローニングを完全オフラインで実現する画期的なモデルだ。150 倍の高速動作、VRAM 1GB の軽量設計、48kHz 高音質出力により、個人開発者でも実用的な音声合成をローカル環境で実行できる。

ElevenLabs のサブスクリプションコストを節約したい開発者、プライバシーを重視する企業、カスタム音声が必要なプロジェクト——LuxTTS はこれらのニーズに応える。

2026 年は「ローカル AI」の元年となる。LuxTTS は、その先駆けだ。

免責事項: 本稿は技術紹介を目的としており、特定のツールの使用を推奨するものではありません。音声クローニング技術の利用は、関連する法律と倫理ガイドラインを遵守してください。

引用元・参考リンク

免責事項 — 掲載情報は執筆時点のものです。料金・機能は変更される場合があります。最新情報は各公式サイトをご確認ください。