目次

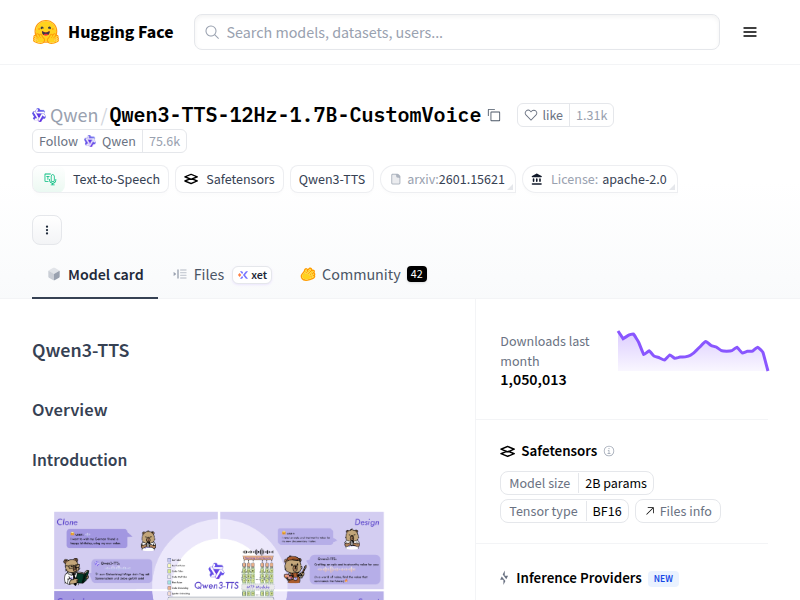

2026 年 3 月、Hugging Face で「ゲームチェンジングな TTS モデルが 110 万ダウンロードを突破」と話題を集めている。これは Alibaba Cloud の Qwen チームが開発した「Qwen3-TTS」で、3 秒の音声から音声クローニング、自然言語での音声設計、97ms の超低遅延ストリーミング生成を実現している。

本稿は Qwen3-TTS の技術的特徴、モデル構成、実用性を解説する。

何ができたか

Qwen3-TTS は以下の 4 つの主要機能を備えている。

第一に、3 秒音声クローニング。Base モデルは 3 秒の参照音声から話者の音声をクローニングできる。話者ごとの学習やファインチューニングは不要だ。

第二に、自然言語音声設計。VoiceDesign モデルは「低めの男性声で、少し落ち着いた感じ」といった自然言語の説明から音声を設計できる。日本語での指示も可能だ。

第三に、97ms 超低遅延ストリーミング。Dual-Track ハイブリッドストリーミング生成アーキテクチャにより、1 文字入力後に即座に最初の音声パケットを出力できる。エンドツーエンドの合成遅延は 97ms だ。

第四に、10 言語対応。日本語、英語、中国語、韓国語、ドイツ語、フランス語、ロシア語、ポルトガル語、スペイン語、イタリア語をカバーし、複数の方言プロファイルにも対応している。

ライセンスは Apache 2.0 で、商用利用も含めて自由に利用可能だ。

モデル構成

Qwen3-TTS は 6 つのモデルを公開している。

| モデル | 特徴 | 言語 | ストリーミング | 指示制御 |

|---|---|---|---|---|

| Qwen3-TTS-12Hz-1.7B-VoiceDesign | 自然言語で音声設計 | 10 言語 | ✅ | ✅ |

| Qwen3-TTS-12Hz-1.7B-CustomVoice | 9 つのプレミアム音色 + 指示制御 | 10 言語 | ✅ | ✅ |

| Qwen3-TTS-12Hz-1.7B-Base | 3 秒音声クローニング / ファインチューニング用 | 10 言語 | ✅ | ❌ |

| Qwen3-TTS-12Hz-0.6B-CustomVoice | 軽量版 CustomVoice | 10 言語 | ✅ | ✅ |

| Qwen3-TTS-12Hz-0.6B-Base | 軽量版 Base | 10 言語 | ✅ | ❌ |

| Qwen3-TTS-Tokenizer-12Hz | 音声エンコーダー/デコーダー | - | - | - |

各モデルの特徴

VoiceDesign:自然言語での音声設計に特化。「若い女性の明るい声」「年配の男性の落ち着いた声」といった指示で音声を生成できる。

CustomVoice:9 つのプレミアム音色(性別・年齢・言語・方言の組み合わせ)に、自然言語での制御を追加。トーン、話速、感情表現を柔軟に調整できる。

Base:3 秒音声クローニングに特化。ファインチューニングのベースモデルとしても使用可能。

0.6B モデル:1.7B モデルの軽量版。リソース制約のある環境向け。

技術的な仕組み

Qwen3-TTS-Tokenizer-12Hz

独自開発の音声トークナイザーで、音声信号を効率的に圧縮し、高次元セマンティックモデリングを実現。パラ言語情報と音響環境特徴を完全に保持し、軽量な非 DiT アーキテクチャを通じて高速・高忠実な音声再構築を可能にする。

ユニバーサルエンドツーエンドアーキテクチャ

離散マルチコードブック LM アーキテクチャを採用し、フルインフォメーションのエンドツーエンド音声モデリングを実現。従来の LM+DiT スキームに固有の情報ボトルネックとカスケーディングエラーを完全に回避し、モデルの汎用性、生成効率、パフォーマンス上限を大幅に向上させている。

超低遅延ストリーミング

Dual-Track ハイブリッドストリーミング生成アーキテクチャにより、単一モデルでストリーミングとノンストリーミングの両方の生成をサポート。1 文字入力後に即座に最初の音声パケットを出力し、エンドツーエンドの合成遅延は 97ms を達成。

クイックスタート

環境セットアップ

# Python 3.12 環境を作成

conda create -n qwen3-tts python=3.12 -y

conda activate qwen3-tts

# qwen-tts パッケージをインストール

pip install -U qwen-tts

# FlashAttention 2(推奨)

pip install -U flash-attn --no-build-isolation

使用例

from qwen_tts import Qwen3TTSModel

# モデルの読み込み

model = Qwen3TTSModel.from_pretrained("Qwen/Qwen3-TTS-12Hz-1.7B-CustomVoice")

# 音声合成

text = "こんにちは、これは Qwen3-TTS のデモです。"

audio = model.generate(text)

# 音声ファイルを保存

model.save_audio(audio, "output.wav")

音声クローニング

# 3 秒の参照音声からクローニング

reference_audio = "path/to/reference.wav"

model.clone_voice(reference_audio)

# クローンした音声で合成

audio = model.generate("クローンした声で話します。")

音声設計

# 自然言語で音声を設計

description = "若い女性の明るい声で、少し元気よく"

audio = model.generate_with_description(text, description)

実用性:他モデルとの比較

| 項目 | Qwen3-TTS | XTTS-v2 | Kokoro-82M |

|---|---|---|---|

| 音声クローニング | 3 秒 | 6 秒 | ❌ |

| 遅延 | 97ms | 200-500ms | 50ms |

| 言語対応 | 10 言語 | 17 言語 | 英語中心 |

| 自然言語制御 | ✅ | ❌ | ❌ |

| ダウンロード数 | 110 万 + | 667 万 + | 912 万 + |

| ライセンス | Apache 2.0 | Apache 2.0 | Apache 2.0 |

メリット

- 3 秒クローニング: 業界最速クラスの音声クローニング

- 自然言語制御: 直感的な音声設計が可能

- 超低遅延: リアルタイム対話に適した 97ms 遅延

- 日本語対応: 10 言語の 1 つとして日本語を正式サポート

- 完全オープンソース: 商用利用も含めて自由

デメリット

- GPU 要件: 1.7B モデルは 8GB 以上の VRAM を推奨

- セットアップの手間: 環境構築が必要(Python、PyTorch など)

- サポート: コミュニティベース(有料サポートなし)

ユースケース

1. AI アシスタント

カスタム音声で AI アシスタントを構築。ブランドに合わせた音声デザインができる。

2. ゲーム開発

NPC のセリフを動的に生成。プレイヤーの名前を呼びかけることも可能だ。

3. ポッドキャスト・動画制作

自分の声でナレーションを自動生成。声優を雇うコストを削減できる。

4. アクセシビリティ

視覚障害者向けの音声読み上げ。個人に最適化した音声を低コストで提供できる。

5. 教育コンテンツ

教材の音声を自動生成。多言語対応の教材も容易に作成できる。

注意点とリスク

1. 音声の悪用リスク

音声クローニング技術は、なりすましや詐欺に悪用される可能性がある。利用者は倫理的なガイドラインを遵守する必要がある。

2. 著作権

クローニングする音声の著作権に注意が必要だ。許可なく他者の声をクローニングすることは法的リスクを伴う。

3. ハードウェア要件

1.7B モデルは 8GB 以上の VRAM を推奨。0.6B モデルは 4GB で動作するが、品質は若干低下する。

4. 多言語対応の限界

日本語を含む 10 言語に対応しているが、英語に比べて品質が低下する言語もある。実使用前に十分テストする必要がある。

結論:TTS の新基準

Qwen3-TTS は、3 秒音声クローニング、自然言語音声設計、97ms 超低遅延を達成した画期的な TTS モデルだ。10 言語対応(日本語含む)と完全オープンソースにより、個人開発者でも高品質な音声合成を実装できる。

Hugging Face で 110 万ダウンロードを突破した事実は、コミュニティがこのモデルを高く評価している証だ。ElevenLabs のサブスクリプションコストを節約したい開発者、プライバシーを重視する企業、カスタム音声が必要なプロジェクト——Qwen3-TTS はこれらのニーズに応える。

2026 年は「ローカル AI」の元年となる。Qwen3-TTS は、その先駆けだ。

免責事項: 本稿は技術紹介を目的としており、特定のツールの使用を推奨するものではありません。音声クローニング技術の利用は、関連する法律と倫理ガイドラインを遵守してください。

引用元・参考リンク

免責事項 — 掲載情報は執筆時点のものです。料金・機能は変更される場合があります。最新情報は各公式サイトをご確認ください。